随着人工智能进入新时代,大语言模型(Large Language Models, LLMs)已成为技术创新的核心驱动力之一。其发展与演进,不仅体现了算法和数据的突破,更是计算机软硬件技术深度协同开发的典范。

一、大语言模型的技术演进路径

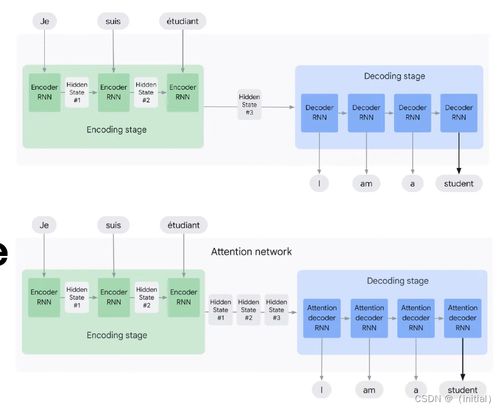

大语言模型的发展经历了从统计语言模型到神经语言模型,再到如今基于Transformer架构的预训练大模型的飞跃。早期模型受限于计算能力和数据规模,功能较为单一。2017年Transformer架构的提出是关键转折点,其自注意力机制有效解决了长距离依赖问题。GPT、BERT等模型开创了“预训练-微调”范式,通过在海量无标注文本上学习通用语言表示,再针对特定任务进行微调,极大提升了模型的泛化能力和效率。模型规模呈现指数级增长,从亿级参数发展到万亿参数,出现了如GPT-3、PaLM、GPT-4等标志性模型。技术演进的核心趋势是“规模扩大”(Scaling Law),即模型性能随参数数量、训练数据和计算量的增加而可预测地提升。技术重点也从单纯的规模扩展,转向提升训练效率(如混合精度训练、优化器改进)、探索更高效的架构(如稀疏专家混合模型MoE)、以及追求更好的对齐能力与安全性。

二、硬件开发的强力支撑与挑战

大语言模型的演进极度依赖底层硬件算力的突破。图形处理器(GPU)及其专用张量核心是训练和推理的基石。英伟达的A100、H100等GPU,凭借其高带宽内存(HBM)和高速互连技术(如NVLink),为千亿级参数的模型训练提供了可能。更进一步的,针对AI负载的专用芯片(ASIC),如谷歌的TPU,通过优化矩阵运算,实现了更高的能效比。

硬件开发面临的核心挑战是“内存墙”和“功耗墙”。超大模型参数需要巨大的存储和高速访问,推动了高带宽内存、异构内存架构以及CPU-GPU协同技术的发展。训练一个大型模型能耗巨大,催生了液冷、沉浸式冷却等先进散热方案,以及从芯片到数据中心级别的能效优化设计。存算一体、光计算等新型计算范式可能成为突破现有瓶颈的关键。

三、软件开发的关键作用与创新

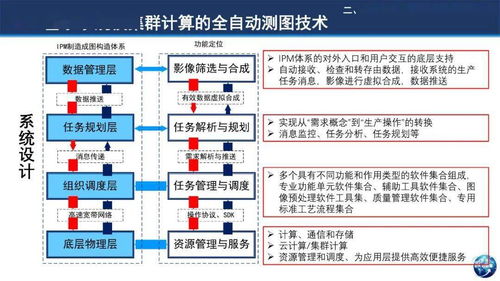

在硬件之上,复杂的软件栈是将算力转化为模型能力的关键。框架层,如PyTorch和TensorFlow,提供了灵活的自动微分和动态图计算,极大简化了模型研发。分布式训练框架(如DeepSpeed、FairScale)通过数据并行、模型并行、流水线并行等策略,实现了超大规模模型在多机多卡集群上的高效训练,解决了单卡内存不足和训练时长的问题。

编译与优化工具(如TVM、TensorRT)将训练好的模型高效部署到各种硬件平台,进行推理优化,降低延迟和成本。庞大的开源生态(如Hugging Face Transformers库)提供了模型、数据集和工具链,大幅降低了研究和应用门槛。软件开发的创新方向包括:更智能的分布式调度、自动混合并行策略、无损或低损的模型压缩与量化技术,以及统一的多框架、多硬件后端支持。

四、软硬件协同开发的未来展望

大语言模型未来的发展将更加依赖软硬件的协同设计与深度优化。硬件方面,计算架构将更贴近AI负载特征,可能出现更多“模型感知”或“算法感知”的定制化芯片。软件方面,系统将更智能地进行资源管理和任务调度,实现计算、存储、通信的极致平衡。

一个重要的趋势是“全栈优化”——从算法模型设计开始,即考虑目标硬件平台的特性(如内存层次、计算单元),编译器中间表示(IR)与神经网络表示(如ONNX)的融合,以及运行时系统的自适应优化。这种垂直整合,旨在消除各层级间的抽象损耗,释放硬件最大潜力。

结论:大语言模型的技术演进是一部算法、数据、算力三者交织前进的历史。计算机软硬件技术不仅是其发展的“土壤”和“引擎”,其本身也在模型需求的强力驱动下不断革新。两者相互促进,共同推动着人工智能向更通用、更高效、更易用的方向迈进。未来的突破,必将诞生于算法创新与软硬件协同开发的更深度融合之中。